No passado dia 5 de junho, Vera Jourova, vice-presidente da Comissão Europeia para os valores e transparência, dizia, após reunião com os signatários do Código de boas práticas para a Desinformação, que a liberdade de expressão pertence aos Humanos, e não às máquinas.

O desenvolvimento da Inteligência Artificial (IA) terá impacto em diversos setores, e o ecossistema informativo não é exceção. Ferramentas como o ChatGPT podem ser um fator de crescimento mas, simultaneamente, de mitigação da desinformação. E por isso mesmo, é importante desenvolver alguns dos desafios VS oportunidades que esta explosão da IA vem trazer:

Desafios:

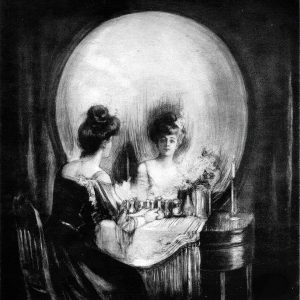

1.A qualidade dos ’embustes’: À medida que a tecnologia de IA avança, aumenta a capacidade de gerar conteúdo desinformativo altamente convincente e sofisticado. Lá se vai a velha máxima do ‘ver para crer’.

A tecnologia Deepfake, por exemplo, pode ser utilizada para criar conteúdos áudio e vídeo manipulados que parecem autênticos. O esbatimento das fronteiras entre conteúdos gerados por humanos e por máquinas pode ter um impacto significativo no valor da autenticidade e da confiança social nos conteúdos

2.Produção em escala: A geração de imagens, vídeos e textos de forma automática permite produzir, para a mesma narrativa, maior variedade e qualidade de conteúdos, dificultando a sua identificação e facilitando a sua criação.

3.Velocidade e dimensão da propagação: A IA pode ser utilizada para disseminar desinformação a uma escala sem precedentes. Os bots (perfis e interações geradas por máquinas) e outros sistemas baseados em IA podem amplificar a propagação de narrativas desinformativas, num período mais curto e com um comportamento menos mecanizado, que dificulte a sua identificação .

4.Redução de custos: A montagem de uma campanha de desinformação profissional, com conteúdos de qualidade, disseminação alargada e com uma aparência ‘orgânica’ vai passar a não estar apenas acessível a estados-nação ou grandes organizações. A AI vem reduzir os custos e torna possível um ‘Cambridge Analytica’ para os eventos do quotidiano e dentro de pequenas comunidades. Pode ainda amplificar opiniões minoritárias. Esta amplificação pode criar a ilusão de um apoio alargado a ideologias extremistas ou divisionistas, influenciando potencialmente o discurso público e os debates políticos.

Mas… nem tudo é sombrio.

A IA traz também oportunidades na capacitação de ferramentas de combate à desinformação:

1.Deteção e atenuação: A IA pode desempenhar um papel crucial no desenvolvimento de ferramentas e técnicas para detetar e mitigar a desinformação e outras ameaças digitais, como o discurso de ódio e o incitamento à violência. Os algoritmos de aprendizagem automática podem analisar grandes quantidades de dados para identificar padrões, anomalias e atividades suspeitas, ajudando a assinalar potenciais casos de desinformação e a combatê-los em tempo real.

2.Verificação de factos: Os sistemas de verificação de factos alimentados por IA podem ajudar a verificar a exatidão das informações, cruzando rapidamente as afirmações com fontes credíveis. As técnicas de processamento da linguagem natural e de aprendizagem automática permitem a verificação automatizada de factos a uma escala muito superior à manual.

Paralelamente, à medida que a autenticidade do conteúdo se torna mais difícil de determinar, aumenta a importância da verificação e da atribuição. Processos fidedignos que verifiquem a fonte e a autenticidade dos conteúdos podem tornar-se cruciais para manter a confiança. As soluções tecnológicas autenticam conteúdos, como as assinaturas digitais ou as marcas de água, podem tornar-se mais importantes para estabelecer a credibilidade.

3.Contextualização: Ferramentas de IA podem ajudar as plataformas a analisar o conteúdo e a apresentar o conteúdo de forma contextualizada, sinalizando, por exemplo, conteúdo desatualizado, imagens adulteradas ou que não correspondem ao conteúdo, tal como títulos que induzem em erro.

4.Contranarrativas: Todas as facilidades explanadas para a criação de uma campanha de desinformação aplicam-se também às campanhas informativas. Importa capitalizar, de forma ética, esta capacidade na criação, em tempo útil, de contranarrativas de esclarecimento.

Para enfrentar os desafios e maximizar as oportunidades associadas ao desenvolvimento da IA é necessária uma estreita colaboração entre os criadores de tecnologia, os decisores políticos, os investigadores e os utilizadores. É fundamental encontrar um equilíbrio entre a inovação e a garantia de uma utilização ética da IA para tirar partido do seu potencial e, ao mesmo tempo, evitar a sua utilização indevida. Para isso, é necessário garantir, acima de tudo, transparência e um forte envolvimento da sociedade civil no desenvolvimento destas tecnologias.